Bisnis.com, JAKARTA – Kemajuan pesat dalam kecerdasan buatan meningkatkan risiko pengguna yang tak bertanggungjawab akan pemanfaatan teknologi untuk melakukan peretasan otomatis, hingga menyebabkan kecelakaan mobil otonom atau mengubah pesawat komersial menjadi senjata.

Menurut riset dalam makalah yang dipublikasikan pada Rabu (21/2/2018) oleh 25 peneliti teknik dan kebijakan publik dari universitas Cambridge, Oxford dan Yale bersama dengan pakar privasi dan militer, memperingatkan penyalahgunaan kecerdasan buatan (artificial intelligence/AI) oleh negara-negara, penjahat, serta hacker.

Dilansir Reuters, para peneliti tersbut mengatakan bahwa penggunaan AI yang salah dapat mengancam keamanan digital, fisik, dan politik dengan memungkinkan serangan berskala besar yang ditargetkan dengan sangat efisien. Studi ini berfokus pada perkembangan yang masuk akal dalam lima tahun.

| Baca Juga 15 Kota Raih Predikat Smart City |

|---|

"Kami semua setuju ada banyak aplikasi AI yang positif. Namun, ada celah seputar masalah penggunaan yang berbahaya," ungkap Miles Brundage, seorang peneliti di Oxford's Future of Humanity Institute, seperti dikutip Reuters.

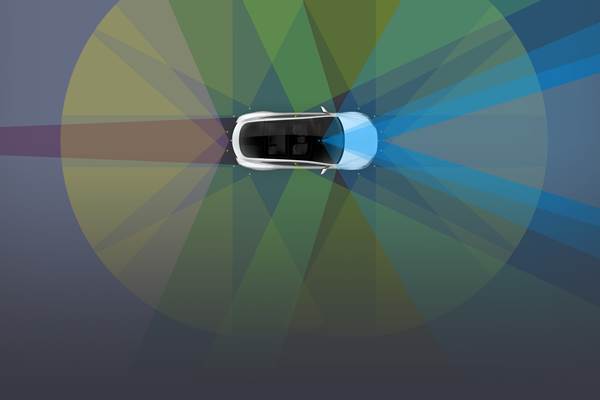

AI melibatkan penggunaan komputer untuk melakukan tugas yang biasanya membutuhkan kecerdasan manusia, seperti mengambil keputusan atau mengenali teks, ucapan atau gambar visual.

Hal ini dianggap sebagai kekuatan yang kuat untuk membuka segala kemungkinan teknis namun telah menjadi fokus perdebatan mengenai apakah otomatisasi tersebut dapat berakibat pada meningkatnya pengangguran, serta dislokasi sosial lainnya.

Makalah ini mengulas perkembangan penelitian akademis tentang risiko keamanan yang ditimbulkan oleh AI dan meminta pemerintah dan pakar kebijakan dan teknis untuk berkolaborasi dan meredakan bahaya ini.

Para peneliti merinci kekuatan AI untuk menghasilkan gambar, teks, dan audio buatan untuk meniru identitas orang lain secara online untuk mempengaruhi opini publik, mencatat ancaman bahwa rezim otoriter dapat menggunakan teknologi semacam itu.

Makalah tersebut juga membuat serangkaian rekomendasi termasuk mengatur AI sebagai teknologi militer/komersial yang memiliki fungsin ganda. Selain itu, makalah tersebut juga mempertanyakan apakah akademisi dan pihak lain harus mengendalikan apa yang mereka publikasikan atau ungkapkan tentang perkembangan baru di AI sampai para ahli lain memiliki kesempatan untuk belajar dan bereaksi terhadap potensi bahaya yang mungkin mereka hadapi.

| Baca Juga Ancaman Keamanan Siber Indonesia Tinggi |

|---|

"Kami akhirnya berakhir dengan lebih banyak pertanyaan daripada jawaban," kata Brundage.

Makalah ini lahir dari sebuah lokakarya di awal 2017, dan beberapa prediksinya pada dasarnya menjadi kenyataan. Para penulis menduga AI dapat digunakan untuk membuat audio dan video palsu yang sangat realistis dari pejabat publik untuk tujuan propaganda.

Akhir tahun lalu, apa yang disebut video porno "deepfake" mulai bermunculan secara online, yang menampilkan wajah selebriti dengan tubuh yang berbeda dan terlihat sangat realistis.

"Itu terjadi dalam rezim pornografi dan bukan propaganda. Namun, yang deepfake tunjukkan tidak bias diterapkan pada propaganda," ungkap Jack Clark, kepala kebijakan di OpenAI, grup besutan CEO Tesla Inc Elon Musk dan investor Silicon Valley Sam Altman untuk fokus pada AI yang bermanfaat bagi umat manusia.

Cek Berita dan Artikel yang lain di Google News dan WA Channel